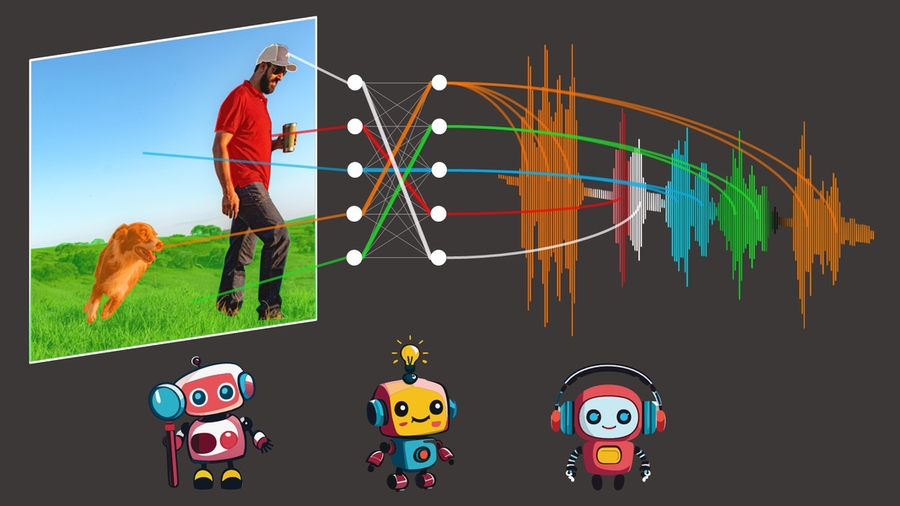

Bilgisayar Bilimi ve Yapay Zeka Laboratuvarı’na (CSAIL) bağlı MIT doktora öğrencisi Mark Hamilton, makinelere öncelikle insan dilini sıfırdan öğreterek hayvan iletişimini anlamak için kullanmayı amaçlıyor. Hamilton ve ekibi, “Penguenlerin Yürüyüşü” filmindeki bir sahneden esinlenerek görsel öğeleri ses ipuçlarından tahmin ederek dili öğrenen ve bunun tersini de yapan DenseAV adında bir model geliştirdi.

DenseAV, konuşulan kelimeler ile görsel öğeler arasındaki ilişkiyi öğrenmek için milyonlarca video klip üzerinde eğitildi. Örneğin, “köpek” kelimesini duyduğunda model, video akışındaki köpek görsellerini arıyor. Model, yazılı dil hakkında önceden bilgi sahibi olmadan, çeşitli görsel-işitsel bağlantı türlerini anlama ve bunlar arasında ayrım yapma yeteneğini göstererek, konuşulan sözcükler ile bunlara karşılık gelen sesleri etkili bir şekilde ayırt etti.

Bu yaklaşım, eşleşen kalıpları belirlemek için işitsel ve görsel sinyal çiftlerini karşılaştırarak karşılaştırmalı öğrenmeyi kullanıyor. Ses kliplerinin tamamını tam görüntülerle eşleştiren önceki modellerden farklı olarak DenseAV, her pikseli ve sesi saniye saniye karşılaştırarak ince taneli karşılaştırmayı ve ayrıntılı bağlantılara olanak tanıyor. Model, iki milyon YouTube videosunu içeren AudioSet üzerinde eğitildi ve hassas değerlendirme için yeni veri kümeleri oluşturuldu.

Zorluklar arasında veri hacminin yönetilmesi ve büyük bir transformatör mimarisine geçiş yer alıyordu. Gelecekteki hedefler arasında büyük miktardaki yalnızca video veya ses verilerinden öğrenen sistemler oluşturmak ve performansı artırmak için dil modeli bilgisini entegre etmek yer alıyor. DenseAV’ın gelişimi, insan açıklaması olmadan eşzamanlı görsel ve işitsel öğrenmede ilerlemeye işaret ederek, daha geniş dil öğrenme uygulamalarına yönelik potansiyeli gösteriyor.

Hamilton’un DenseAV modeli, insan dilini anlamanın ötesinde önemli kolaylıklar da sağlayacak. Yunuslar veya balinalar gibi yazılı formları olmayan hayvan iletişimini anlamak için potansiyel olarak uygulanabilir. Ek olarak yöntem, sismik sesler ve jeoloji gibi diğer sinyal çiftlerindeki kalıpları keşfetmek için de kullanılabilir. Araştırma, makinelerin kapsamlı gözlem ve çevreleriyle etkileşim yoluyla dil ve iletişim öğrenme potansiyelinin altını çiziyor.

Katkıda bulunan kişiler arasında ABD Ulusal Bilim Vakfı ve diğer kuruluşların desteğiyle Andrew Zisserman (Oxford Üniversitesi), John R. Hershey (Google AI) ve William T. Freeman (MIT) bulunmaktadır. Araştırma IEEE/CVF Bilgisayarlı Görme ve Örüntü Tanıma Konferansı’nda sunulacak.

Resimler: Mark Hamilton